OpenClaw 配置新闻摘要助手

OpenClaw 龙虾很火,最近开始尝试本地部署一个小龙虾玩玩。 安装过程很简单,根据 官方文档-安装步骤 直接脚本一键安装。 curl -fsSL https://openclaw.ai/install.sh | bash 安装过程中会根据提示确认一

Llama 4 Scout和Llama 4 Maverick两款原生多模态大模型但拥有 128 位专家。它在广泛的基准测试中超越了 GPT-4o 和 Gemini 2.0 Flash,并且在推理能力和编程等任务上与 DeepSeek v3 相比仅需不到一半的活跃参数就能达到相似的表现2025 年 2 月 24 号-2 月 28 号,DeepSeek 开源了大模型领域的多个关键软件,推动 AGI 向前发展。

你以为这就结束了?今天 (3 月 1 号) DeepSeek 又给出了一份汇总性的内容,总结自己利用这些关键技术,构建自己的推理系统的。

先说结论:

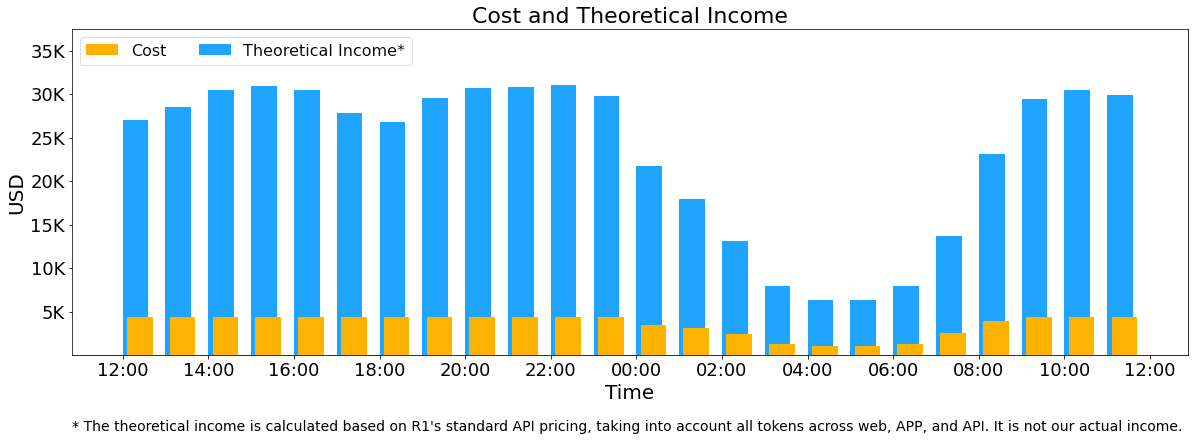

基本上压榨全部的 GPU 资源了。